前言

我在安装中遇到的坑也是踩了又踩,还真不少。我总结了一下,给几点经验和建议吧

一、步骤:

windows安装

在Windows上本地部署安装Gemma 4,最推荐的方式是使用 Ollama。这是一个专为本地大模型设计的工具,它能帮你自动处理模型下载、环境配置和API服务,整个过程非常简单。

第一步:准备工作:选择你的 Gemma 4 版本。

第二步:安装 Ollama 运行环境

- 访问 Ollama 官方网站:https://ollama.com/download

- 下载 Windows 版本的安装程序 (通常是 OllamaSetup.exe)。

- 双击下载的 .exe 文件,按照提示完成安装。安装完成后,Ollama 会在后台运行,你可以在系统托盘中找到它的图标。

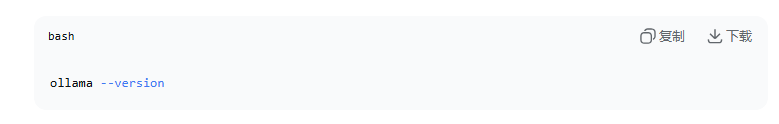

- 验证安装:按下 Win + R,输入 cmd 并回车打开命令提示符,然后输入以下命令并按回车:

- 如果显示出版本号(如 0.6.0),就说明安装成功了

第三步:下载并运行 Gemma 4 模型

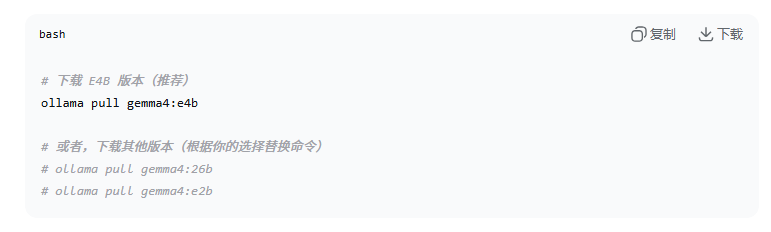

- 1.下载模型:在刚才的命令提示符窗口中,输入以下命令并回车,即可开始下载你选择的模型。

- Ollama 会显示下载进度,模型文件通常有几个GB大小,请耐心等待

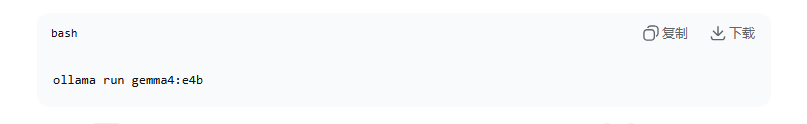

- 2.开始对话:下载完成后,输入以下命令并回车,就能进入对话界面了:

- 当看到 >>> 提示符时,就可以输入你的问题,像使用ChatGPT一样和它聊天了。输入 /bye 可以退出对话模式。

- 如果显示出版本号(如 0.6.0),就说明安装成功了

第四步:(可选)进阶配置与集成

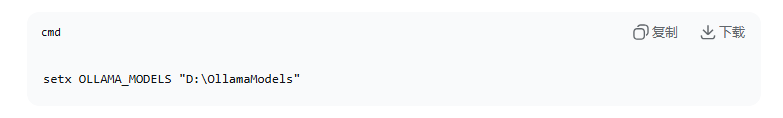

1.更改模型下载路径(重要) Ollama 默认将模型下载到C盘。如果C盘空间紧张,建议修改到其他盘符更改模型下载路径(重要) Ollama 默认将模型下载到C盘。如果C盘空间紧张,建议修改到其他盘符

方法一:设置系统环境变量

- 在Windows搜索框输入“环境变量”,打开“编辑系统环境变量”。

- 点击“环境变量” → 在“系统变量”下点击“新建”。

- 变量名:OLLAMA_MODELS

- 变量值:D:\OllamaModels (请替换为你想要的目标文件夹路径)

- 确定保存后,重启电脑或重启Ollama服务使配置生效。

方法二:在启动Ollama前设置

- 在启动Ollama之前,在命令提示符中运行以下命令,此方法仅对当前终端窗口有效:

2.让模型常驻内存

如果你内存充足,可以设置让模型一直留在内存中,避免每次对话都重新加载,提升响应速度。

- 同样通过设置系统环境变量 OLLAMA_KEEP_ALIVE,并将其值设置为 -1。

3.开启API服务

Ollama安装后会自动在后台启动一个API服务,地址是 http://localhost:11434。这意味着你可以用任何支持OpenAI API格式的客户端或代码来调用本地的Gemma 4模型。

- Python 调用示例:

macOS/LINUX安装自行测试。

常见问题

模型文件较大,网络波动可能导致下载失败。Ollama的 pull 命令支持断点续传,直接重新运行 ollama pull gemma4:e4b 即可继续下载

这说明你选择的模型超出了电脑硬件能力。 解决方案:在命令提示符中按 Ctrl+C 终止当前模型,然后换一个更小的模型版本,例如从 gemma4:26b 换成 gemma4:e4b

可以尝试 LM Studio。这是另一个非常流行的本地模型部署工具,提供漂亮的图形界面,可以在其内部搜索、下载Gemma 4模型并直接聊天,无需使用命令行

待编辑

待编辑

待编辑

待编辑

待编辑

- 待编辑

- 待编辑

- 待编辑

- 待编辑

- 待编辑

- 待编辑

有什么问题直接留言,我们会一一解答